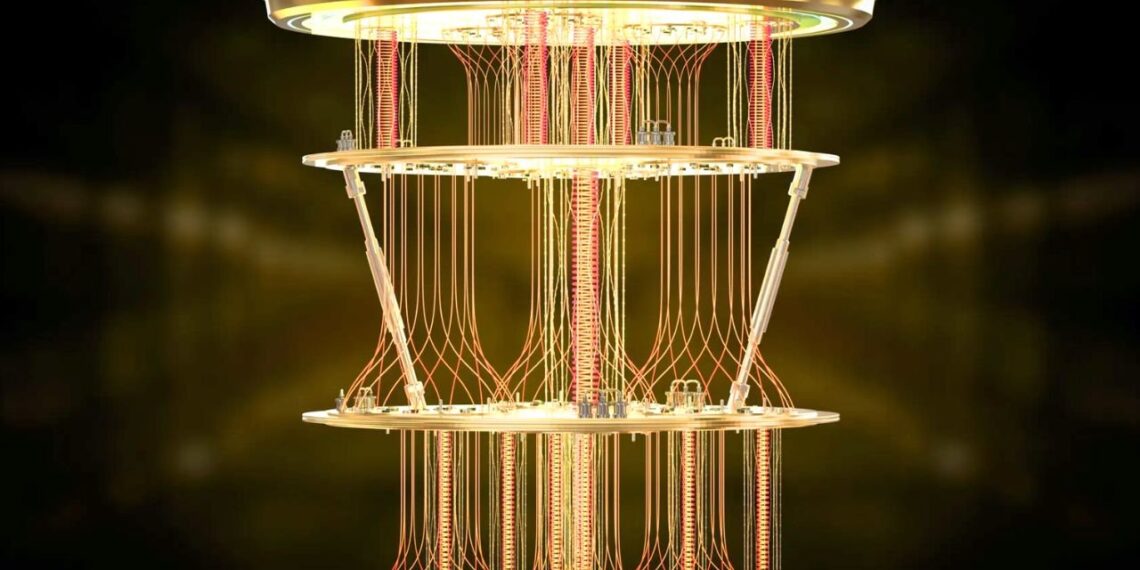

Il supercomputer JUPITER, installato al Jülich Supercomputing Centre in Germania, ha appena superato una soglia simbolica: la simulazione completa di un computer quantistico universale da 50 qubit.

Il precedente record si fermava a 48 qubit, un limite già raggiunto dallo stesso team in una tappa anteriore. Nel mondo del calcolo, due qubit in più non sono “un piccolo progresso”, sono un gradino esponenziale. La dimostrazione non dice che le macchine quantistiche sono superate, ricorda piuttosto una realtà: simulare il quantistico resta uno strumento centrale per progettare algoritmi, verificare risultati e preparare gli usi. La performance si basa su una combinazione molto concreta, un’architettura di memoria capace di assorbire volumi giganteschi e un software di simulazione ottimizzato per sfruttare questa memoria senza crollare lungo la strada.

Jülich supera la soglia dei 50 qubit

Il record sta in un punto preciso, la simulazione “completa” di un calcolo quantistico universale, non un’approssimazione, non un caso giocattolo. A 50 qubit, lo stato quantistico da rappresentare esplode, ogni qubit aggiunto raddoppia le esigenze, il che trasforma la progressione in un muro. I team di Jülich hanno già firmato la tappa precedente a 48 qubit, e dimostrano qui che la barriera non era teorica, ma di infrastruttura.

Per dare un ordine di grandezza, simulare 50 qubit richiede circa 2 petabyte di memoria, vale a dire quasi due milioni di gigabyte. Su un portatile si resta intorno a poche decine di qubit, tipicamente 30 qubit secondo gli ingegneri, oltre i quali le risorse mancano. La prof.ssa Kristel Michielsen, direttrice al Jülich Supercomputing Centre, insiste sul legame diretto tra progressi del calcolo ad alte prestazioni e ricerca quantistica.

Questo tipo di simulazione fa da banco di prova prima che processori quantistici sufficientemente affidabili siano ampiamente disponibili. Approcci come il VQE per la modellazione molecolare o il QAOA per l’ottimizzazione possono essere valutati, confrontati, sottoposti a stress test. Ma occorre tenere una sfumatura: una simulazione perfetta non sostituisce il comportamento di un hardware reale soggetto al rumore, aiuta soprattutto a preparare, calibrare e capire.

JUQCS-50 e gli NVIDIA GH200 al cuore del salto

La performance non viene solo dal “grosso ferro”. Il software JUQCS-50, evoluzione del Jülich Universal Quantum Computer Simulator, è stato adattato per sfruttare un’architettura di memoria ibrida. Il punto chiave, gli NVIDIA GH200 accoppiano strettamente CPU e GPU, il che permette di deviare temporaneamente dati oltre la memoria GPU verso la memoria CPU, con una perdita di prestazioni limitata.

La sfida è matematica e logistica. A ogni operazione quantistica, l’algoritmo deve aggiornare oltre 2 quadrilioni di valori numerici complessi, un “2” seguito da 15 zeri, poi sincronizzare questi dati su migliaia di nodi. Se la circolazione dei dati si satura, tutto crolla. Gli specialisti hanno quindi lavorato sui trasferimenti, sull’ordinamento e sull’efficienza, perché la simulazione resti stabile a questa scala.

Nei comunicati tecnici, i team menzionano anche una compressione tramite codifica di byte, presentata come un guadagno di un fattore 8, e un’ottimizzazione dinamica degli scambi su oltre 16.000 superchip. Il prof. Hans De Raedt, citato come autore principale, mette in evidenza un’emulazione “ad alta fedeltà”. Anche qui, prudenza: la fedeltà dipende dal modello e dalle ipotesi, ma l’infrastruttura apre un terreno di sperimentazione raramente accessibile.

Perché questo record pesa su IA, clima e quantistico

Il messaggio politico e industriale è chiaro: l’exascale europeo non è solo un trofeo. JUPITER è annunciato come capace di raggiungere l’ordine dell’exascale, ossia un quintilione di operazioni FP64 al secondo, e punta a usi trasversali, simulazione, addestramento e inferenza di grandi modelli di IA, clima, biologia strutturale, ingegneria, astrofisica. Il quantistico si inserisce in questa lista come un settore in cui servono strumenti di validazione.

Viene messo in evidenza un altro indicatore, l’efficienza energetica. JUPITER è presentato come il più efficiente tra i primi cinque sistemi della classifica TOP500, intorno ai 60 gigaflops per watt. In un contesto in cui l’elettricità diventa un vincolo strategico, questo tipo di rapporto conta quasi quanto la velocità grezza. Ma va anche detto: simulare 50 qubit mobilita risorse gigantesche, non è uno strumento “di tutti i giorni”.

Per la ricerca quantistica, l’interesse è immediato: testare circuiti, confrontare strategie, verificare risultati sperimentali prima di prenotare tempo su macchine quantistiche rare. Per l’industria, il beneficio è più indiretto, gli algoritmi di ottimizzazione come QAOA interessano la logistica o la finanza, ma si parla ancora di preparazione. L’avanzamento mostra soprattutto che il calcolo classico ha ancora margini, a condizione di investire nelle architetture di memoria e nei software.

Da ricordare

- JUPITER ha simulato un computer quantistico universale da 50 qubit, oltre il record di 48.

- La simulazione richiede circa 2 petabyte di memoria e una sincronizzazione massiccia dei dati.

- JUQCS-50 sfrutta una memoria ibrida CPU-GPU tramite i superchip NVIDIA GH200.

- Il record illustra il ruolo dei supercomputer exascale per testare algoritmi quantistici come VQE e QAOA.

Fonti

- JUPITER supercomputer breaks world record with 50-qubit quantum simulation | ScienceDaily

- New Record on JUPITER: Simulating a 50-Qubit Quantum Computer

- JUPITER supercomputer nails full 50-qubit quantum simulation record

- HPCwire – Since 1987 – Covering the Fastest Computers in the World and the People Who Run Them

- NVIDIA Powers Europe’s Fastest Supercomputer | NVIDIA Newsroom