I dettagli tecnici della memoria ZAM, presentata come alternativa “anti-HBM”, stanno diventando più concreti: un modulo con impilamento a nove strati, con otto layer DRAM e un layer di controllo, e una capacità che arriva a 9 GB per stack (1,125 GB per ciascun layer DRAM).

La promessa è ambiziosa: avvicinarsi alla banda delle soluzioni di fascia alta e ridurre i colli di bottiglia che oggi frenano molte piattaforme AI. Il contesto è chiaro: la memoria ad alta banda è diventata un elemento determinante per GPU e acceleratori. Nvidia, con la piattaforma Vera Rubin, parla di HBM4 fino a 22 TB/s di banda di memoria. ZAM nasce per mettere pressione a quel modello, puntando su stacking estremo e tecniche di packaging avanzate, ma con compromessi che non vanno ignorati, a partire dalla capacità per stack.

Intel e SAIMEMORY descrivono ZAM con 9 strati e bonding ibrido

La fotografia più nitida di ZAM arriva dalla sua struttura fisica: uno stack alto 9 strati, dove gli 8 layer DRAM sono sormontati da un layer di controllo dedicato alla gestione dei flussi dati. Ogni layer di DRAM contiene circa 1,125 GB, e il totale dichiarato per modulo si ferma a 9 GB. Non è un numero casuale: è la conseguenza diretta di un design che privilegia densità di connessioni e velocità di trasferimento rispetto alla capienza.

Il cuore del progetto è l’uso di tecniche di hybrid bonding e di un impilamento estremamente sottile: tra un layer DRAM e l’altro compare un substrato di silicio di circa 3 micrometri. In pratica si lavora su spessori che, nel mondo industriale, rendono più delicata la resa produttiva e la gestione meccanica. “Quando scendi a pochi micrometri, la sfida non è solo elettrica, è fisica”, sintetizza Marc, ingegnere di packaging avanzato sentito in ambito accademico, sottolineando che il vantaggio prestazionale rischia di costare caro in complessità.

Un altro dettaglio rilevante riguarda i collegamenti verticali: lo schema tecnico parla di TSV e connessioni a “anelli” metallici, con una logica di distribuzione della corrente e del segnale pensata per sostenere throughput elevati. In alcune descrizioni si cita un ordine di grandezza di circa 13.700 TSV per layer, valore che dà l’idea della densità di interconnessione. È qui che ZAM prova a differenziarsi: non solo stacking, ma stacking con un numero di vie verticali tale da ridurre la distanza effettiva tra compute e memoria.

Capacità 9 GB per stack, banda stimata tra 1,6 e 2,5 TB/s

La capacità è il primo punto che fa discutere: 9 GB per modulo, con 1,125 GB per layer DRAM, è molto meno dei valori associati alle generazioni più recenti di HBM, dove la capacità per singolo stack pu salire parecchio. Questo significa che ZAM, almeno nella prima incarnazione descritta, sembra pensata per scenari in cui conta più alimentare continuamente i core di calcolo che ospitare grandi quantità di parametri “in locale”. Tradotto: ottima per throughput, meno per modelli che vogliono restare il più possibile in memoria vicina al chip.

Sulla banda, il consorzio non ha ancora messo un numero definitivo sul data rate, ma circolano stime legate a precedenti affermazioni di un vantaggio tra 2x e 3x rispetto a HBM3. Se si prende come riferimento un valore di 819 GB/s per HBM3, la proiezione porta a una banda nell’ordine di 1,6-2,5 TB/s per modulo. È un intervallo ampio, e qui arriva la prima critica: senza un valore certificato di velocità e consumi, la parola “HBM-killer” resta più uno slogan tecnico che un dato verificabile.

Un’altra stima, più aggressiva, parte da una densità di banda di circa 0,25 Tb/s per mm e porta, per un’area chip indicata di 171 mm, a circa 5,3 TB/s per modulo. Numeri del genere, se confermati in prodotti reali, cambierebbero la conversazione, perché supererebbero persino la velocità per stack attribuita a HBM4 in alcune comparazioni. Ma resta un “se”: in laboratorio si pu mostrare un picco, in produzione si deve garantire stabilità, yield e costi accettabili.

Nvidia Vera Rubin spinge HBM4 a 22 TB/s, ZAM punta a ridurre colli di bottiglia

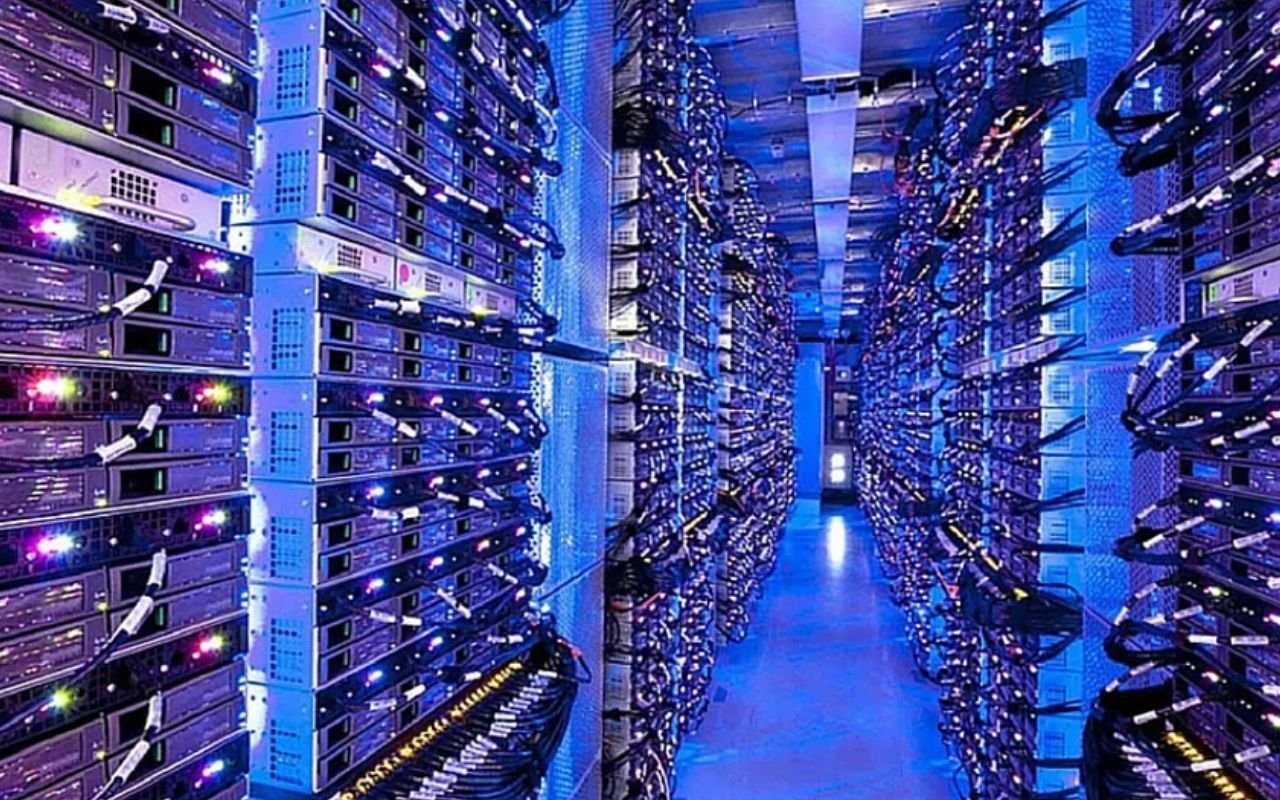

Il benchmark implicito, oggi, è la piattaforma Nvidia Vera Rubin, dove la stessa Nvidia indica fino a 22 TB/s di banda di memoria HBM4 per GPU. Sono numeri che spiegano perché tutti cercano alternative: con workload AI su contesti lunghi, MoE e inferenza ad alto batch, la banda memoria diventa un acceleratore “invisibile”. Se la memoria non tiene il passo, la GPU resta sotto-utilizzata, e il costo per token sale. ZAM prova a inserirsi proprio in quel punto, promettendo più efficienza e prestazioni.

Il tema non è solo la velocità, ma anche potenza e calore: l’industria sta cercando modi per alleggerire i vincoli energetici delle memorie ad alta banda. Qui entra in gioco la collaborazione tra Intel e SAIMEMORY, con il supporto di partner di ricerca e programmi pubblici giapponesi per la commercializzazione. C’è anche un orizzonte temporale che raffredda gli entusiasmi: si parla di una traiettoria che guarda al 2029 per arrivare a prodotti sul mercato, quindi non è una soluzione per i server AI che si acquistano domani.

C’è poi un’incognita industriale: chi produrrà la DRAM sottostante e su quali nodi. Alcune ricostruzioni ipotizzano un ruolo delle fonderie Intel, ma senza dettagli sul processo. Per i clienti, questo conta quanto la banda: supply chain, volumi e affidabilità decidono la diffusione più delle slide. Marc, dal lato integratori, la mette giù semplice: “Se mi dai 2 TB/s in più ma mi consegni tardi o a prezzo ingestibile, io resto su HBM”. Ed è il punto: ZAM pu diventare una leva competitiva reale solo se prestazioni, capacità e producibilità trovano un equilibrio credibile.